Robert Alexander verbringt einen Teil seines Arbeitstages damit, einem sanften Rauschen zuzuhören, ähnlich wie das Rauschen des fallenden Wassers, das man während eines Regenschauers außerhalb des Hauses hört. Gelegentlich hört er einen anormalen Klang und markiert die entsprechende Zeit in der Audiodatei. Alexander hört dem Magnetfeld der Sonne zu und markiert potenziell interessante Regionen. Nach nur zehn Minuten hat er die Datenmenge eines ganzen Monats durchgehört.

Alexander ist ein Doktorand an der University of Michigan. Er ist ein Vertonungsspezialist, der Sonnenphysikern am Goddard Space Flight Center der NASA in Greenbelt (Maryland) darin schult, geringe Unterschiede festzustellen, indem sie sich Satellitendaten anhören, anstatt sie anzusehen.

Sonifikation (Verklanglichung oder Vertonung) ist der Prozess, bei dem irgendeine Datenform oder Messung als Klang dargestellt wird – beispielsweise das Piepen eines Herzfrequenzmessgerätes bei der Pulsmessung einer Person oder eine Türklingel, die jedes Mal klingelt, wenn eine Person einen Raum betritt. In diesem Fall sind es Explosionen, die auf große Ereignisse auf der Sonne hinweisen. In bestimmten Fällen können Wissenschaftler ihre Ohren statt Augen benutzen, um die Daten schneller zu verarbeiten und mehr Einzelheiten zu erkennen als bei einer visuellen Analyse. In der Juli-Ausgabe des Journal of Geophysical Research: Space Physics wurde eine Abhandlung über die Effektivität der Vertonung bei der Analyse von NASA-Satellitendaten veröffentlicht.

„Die NASA produziert mit ihren Satelliten eine riesige Datenmenge. Die Sichtung solch großer Datenmengen kann schwierig sein“, sagte Alexander. „Die Vertonung bietet eine vielversprechende Ergänzung zu den üblichen visuellen Analysemethoden.“

Dem Weltraum zuhören

Alexanders Augenmerk liegt darauf, den Erfolg dieser Methoden zu verbessern und zu beziffern. Das Team erzeugte Audiodateien aus den Daten und teilte sie mit den Forschern. Obwohl die ursprünglichen Daten des Wind-Satelliten nicht in einem Audioformat vorliegen, zeichnet der Satellit elektromagnetische Störungen auf, die direkt in Audiosamples umgewandelt werden können. Alexander und sein Team nutzten selbstgeschriebene Computeralgorithmen, um diese elektromagnetischen Frequenzen in Klänge umzuwandeln. In den unten eingebundenen Multimediaclips sind die Klänge des Weltraums zu hören.

Die Verarbeitung einer unglaublichen Datenmenge

Alexander verwendet Clips wie diese, um die Vertonungsmethoden zu verbessern und um die unglaublichen Datenmengen der Satelliten zu bewältigen. Zum Beispiel arbeitet er mit dem Weltraumwissenschaftler Robert Wicks vom Goddard Space Flight Center zusammen, um die hochaufgelösten Beobachtungen der Sonne zu analysieren. Wicks untersucht den stetigen Teilchenstrom von unserem nächstgelegenen Stern: den Sonnenwind. Dieser Wind kann Weltraumwettereffekte auslösen, die menschliche Technologien in Erdnähe beeinträchtigen. Das Team verwendet Daten des NASA-Satelliten Wind. Der Satellit wurde im Jahr 1994 gestartet und befindet sich an einem Punkt zwischen Erde und Sonne, wo er die Temperatur, Dichte, Geschwindigkeit und Magnetfelder des Sonnenwinds ständig beobachtet.

Video-Link: https://youtu.be/U0ZSMymPEIA

Dieser Clip besteht aus drei Teilen: Ein trillerndes Geräusch, das zu einem kurzen Klopfen mit etwas höherer Frequenz führt. Danach folgt ein stilleres Segment, in dem ein zischendes Breitbandgeräusch zu hören ist. Dieser Clip basiert auf Daten, die der NASA-Satellit Wind am 20. November 2007 gesammelt hat. Man hört eine umgekehrte Schockwelle, die auftritt, wenn ein schneller Plasmastrom von einem langsameren gefolgt wird. (Robert Alexander, NASA / University of Michigan)

Wicks analysiert Veränderungen in den Magnetfelddaten des Wind-Satelliten. Solche Daten enthalten nicht nur Informationen über den Sonnenwind. Ein besseres Verständnis derartiger Veränderungen könnte helfen, eine Vorwarnung für problematische Weltraumwetteraktivitäten zu geben, die Satelliten in Erdnähe beeinträchtigen können. Der Wind-Satellit liefert auch eine Fülle von Magnetometerdaten, weil der Satellit das Magnetfeld elfmal pro Sekunde misst. So große Informationsmengen sind nützlich – aber nur dann, wenn sämtliche Daten analysiert werden können.

„Es gibt eine sehr lange, genaue Zeitreihe von Daten, was einen fantastischen Einblick in die Veränderungen des Sonnenwinds gibt und verdeutlicht, was in kleinen Maßstäben geschieht“, sagte Wicks. „Dort läuft eine Vielfalt an physikalischen Prozessen ab, aber es sind mehr Daten, als ich sichten kann.“

Die traditionelle Datenverarbeitungsmethode besteht darin, eine begründete Vermutung darüber abzugeben, wo sich ein bestimmtes Ereignis im Sonnenwind (etwa geringe Wellenbewegungen aufgrund heißen Plasmas) zeigen könnte, gefolgt von der visuellen Suche, die sehr zeitaufwändig sein kann. Stattdessen hört sich Alexander schnellere Versionen der Wind-Satellitendaten an und erstellt eine Liste erwähnenswerter Regionen, die Wissenschaftler wie Wicks ansehen und eingehender analysieren können, was den Prozess beschleunigt.

In einem Beispiel analysierte Alexanders Team Datenpunkte des Wind-Satelliten vom November 2007 und erstellte aus drei Stunden Echtzeitaufzeichnungen einen drei Sekunden langen Audioclip. Für ein ungeübtes Ohr klingen die Daten wie die Aufzeichnung eines Mikrofons an einem windigen Tag. Als Alexander diese Klänge einem Forscher präsentierte, konnte dieser jedoch ein typisches Geräusch am Anfang des Audioclips identifizieren, dem ein klopfendes Ereignis und abschließend ein lauter Knall folgte.

Video-Link: https://youtu.be/gbcWuqclEao

Dieser Clip ist der oben eingebundene Clip, nur rückwärts abgespielt. Geübte Zuhörer werden hier bemerken, dass die rückwärts abgespielte umgekehrte Schockwelle ähnlich wie eine normale Schockwelle klingt. (Robert Alexander, NASA / University of Michigan)

Die Umwandlung der Daten in Klänge

Alexander übersetzt die Daten in Audiodateien. Dafür benutzt er einen Prozess, der als Audifikation bezeichnet wird – eine spezielle Art von Sonifikation, bei der unbearbeitete Rohdaten von Satelliten direkt angehört werden. Die Übersetzung dieser Daten in Audiodateien kann mit der Vorgehensweise verglichen werden, wenn eine Person in einem Tonstudio in ein Mikrofon singt und die Klänge mit einem Bandaufzeichnungsgerät aufgenommen werden. Wenn eine Person in ein Mikrofon singt, registriert es Druckveränderungen und konvertiert die Drucksignale in Veränderungen der magnetischen Intensität mittels eines elektrischen Signals. Die elektrischen Signale werden auf dem Band gespeichert. Magnetometer an Bord des Wind-Satelliten messen die Veränderungen der Magnetfelder direkt und erzeugen ein ähnliches elektrisches Signal. Alexander schreibt ein Computerprogramm, um diese Daten in eine Audiodatei zu übersetzen.

„Die Töne kommen natürlicherweise aus den Daten heraus. Wenn in den Daten eine Frequenz eingebettet ist, dann wird diese Frequenz als Klang hörbar“, sagte Alexander. Das Anhören von Daten ist nicht neu. In einer Studie aus dem Jahr 1982 nutzten Forscher die Audifikation, um Mikrometeoroiden zu identifizieren, welche die Raumsonde Voyager 2 bei ihrem Vorbeiflug an den Saturnringen trafen. Die Einschläge waren in den Daten nicht visuell zu erkennen, konnten aber leicht gehört werden – sie klangen wie starke Impulse, fast wie ein Hagelschauer.

Video-Link: https://youtu.be/4MSZLx8YYhY

Dieser Clip enthält hörbar gemachte Daten der Raumsonde Ulysses vom 26. Oktober 1995. Die Teilnehmer an Alexanders Studie waren in der Lage, künstliche Geräusche des Instruments wahrzunehmen, die er in der vorangegangenen visuellen Analyse nicht gesehen hatte. Hier kann das künstliche Geräusch als ein abweichender Ton gehört werden. (Robert Alexander, NASA / University of Michigan)

Diese Methode wird in der wissenschaftlichen Gemeinschaft jedoch nicht oft angewandt, weil sie ein bestimmtes Maß an Vertrautheit mit den Klängen erfordert. Zum Beispiel muss der Zuhörer verstehen, wie typische Sonnenwindturbulenzen klingen, um anormale Ereignisse zu identifizieren. „Es geht darum, das Ohr zu benutzen, um geringe Unterschiede festzustellen“, sagte Alexander.

Alexander verbrachte anfangs viele Monate mit Wicks, um ihm beizubringen, wie man Magnetometerdaten anhört und bestimmte Elemente hervorhebt. Aber die harte Arbeit zahlt sich aus, weil die Analysen schneller und leichter ablaufen, was zu neuen Bewertungen der Daten führt. „Ich habe die Daten nie zuvor angehört“, sagte Wicks. „Es hat definitiv eine andere Perspektive eröffnet.“

Video-Link: https://youtu.be/bAsgpK8blUo

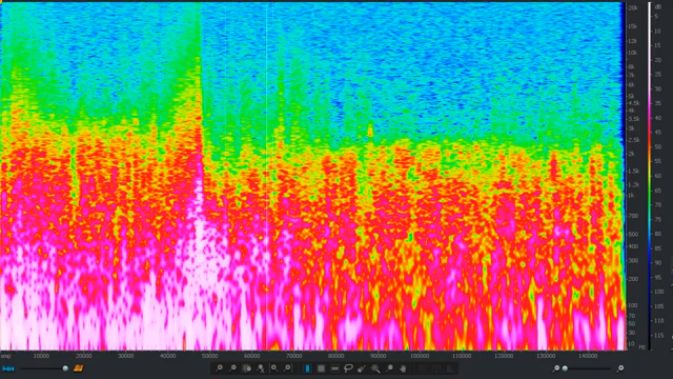

Der Teilnehmer der Studie konnte korrekt vorhersagen, wie diese Daten in einer traditionellen Grafik aussehen würden. Er schlussfolgerte, dass sich das Zwitschern in einem Spektrogramm als besondere Spitze zeigen würde. Spektrogramme zeigen verschiedene Frequenzbereiche in den Wellen, die von dem Wind-Satelliten aufgezeichnet wurden. Der Teilnehmer sagte auch korrekt voraus, dass sich das klopfende Ereignis in einem entsprechenden Spektrogramm als steiler Abfall zeigen würde. (Robert Alexander, NASA / University of Michigan)

Quelle: http://www.nasa.gov/content/goddard/more-than-meets-the-eye-nasa-scientists-listen-to-data/

(THK)

Antworten